Workshop Mang(ai)fying Bias

Poslední část našeho seriálu k projektu Supercharged by AI představí druhý workshop. Tentokrát se podíváme pod lupou na zkreslení, která může umělá inteligence ve svých odpovědích generovat. Stejně jako předchozí materiály, i tento workshop připravila organizace Tactical Tech [1].

Umělá inteligence je dnes jedním z nejčastěji skloňovaných pojmů. Objevuje se v reklamách, ve zprávách i v běžných aplikacích, které každý den používáme. Z marketingových sloganů by se mohlo zdát, že jde o neutrální, objektivní nástroj, který zefektivní práci a pomůže nám dělat chytřejší rozhodnutí. Jenže AI není ani zcela „umělá“, ani skutečně „inteligentní“. Vzniká z lidské práce, využívá obrovské množství dat sesbíraných na internetu. A spolu s nimi přejímá i naše chyby, předsudky a nerovnosti.

Workshop je připraven jako 90minutová interaktivní aktivita, vhodná pro středoškoláky i dospělé. Díky modulárnímu pojetí lze ale využít i jen vybrané části. Účastníci pracují s prezentací, tištěnými případovými studiemi, papírem a fixami, ale hlavně s vlastní zkušeností a kritickým myšlením. Program je navržen tak, aby se každý mohl aktivně zapojit, sdílet své představy o AI, přemýšlet ve skupině nad konkrétními příklady i samostatně reflektovat svoji zkušenost.

Aktivita na začátek

Účastníci se rozdělí do dvojic. Každý popíše partnerovi první obraz/představu, která se mu vybaví, když se řekne umělá inteligence. Může jít o cokoliv od robotů přes počítačové sítě až po sci-fi postavy. Na vyjádření své představy mají 3 minuty, během nichž ji zároveň nakreslí na papír. Po uplynutí času si role vymění a dalších 3 minuty kreslí druhý účastník. Po celkem 6 minutách se celá skupina/třída znovu sejde dohromady. Všichni své obrázky krátce představí. Cílem aktivity je udělat si vzájemně představu o tom, jak účastníci vnímají umělou inteligenci.

Co se skrývá za pojmem „umělá inteligence“

Úvodní část účastníky provádí demystifikací samotného pojmu artificial intelligence/umělá inteligence. Diskutuje se, proč může být zavádějící a jak upozorňuje badatelka Kate Crawford, AI není ani zcela „umělá“ (protože stojí na lidské práci a přírodních zdrojích), ani zcela „inteligentní“ (protože jde o systémy ovládané a naprogramované lidmi). Důležité je zdůraznit, že jde o jazykové modely, které jsou trénovány na datech z internetu, které mohou být zkreslené, nenávistné nebo neetické.

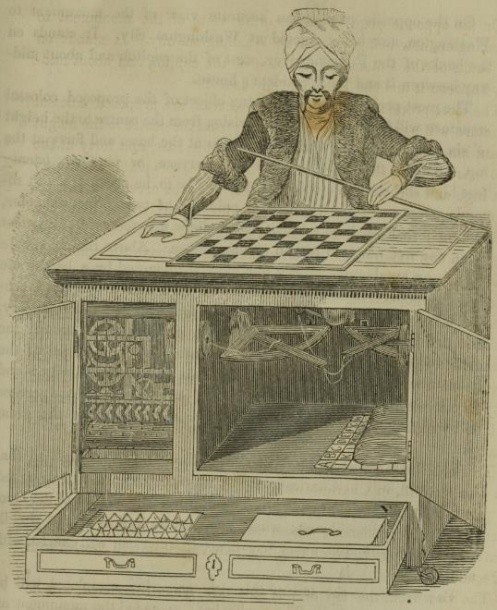

Velký prostor dostává i otázka, odkud se data, z nichž výstupy vznikají, berou. Například generátor obrázků Stable Diffusion byl natrénován na více než pěti miliardách webových stránek, mezi nimiž byla i díla umělců, kteří s tímto využitím svých děl nikdy nesouhlasili. Připomíná to slavný podvod 18. století, Mechanického Turka, šachový automat, který ve skutečnosti ovládal ukrytý člověk. Stejně tak i dnešní AI často působí jako kouzelná, ve skutečnosti ale stojí na práci tisíců špatně placených lidí z různých odvětví.

Když technologie selhává

Prostřední část workshopu je věnována případovým studiím. Účastníci pracují ve skupinách s konkrétními příběhy, kde AI místo pomoci selhala a poškodila lidi:

- pasová kontrola, která chybně vyhodnotila rysy černošského muže,

- algoritmus rozpoznávání obličejů, jenž vedl k nespravedlivému zatčení,

- zdravotnický software, který nedokázal spravedlivě vyhodnotit rizika pacientů z odlišných sociálních prostředí,

- nedostatek dat pro klimatický výzkum v důsledku geopolitických konfliktů.

Následná diskuze se pak soustředí na otázky:

- kdo z technologie těží,

- kdo naopak trpí,

- zda přínosy vyvažují rizika,

- komu vlastně patří moc nad algoritmy.

Často se ukazuje, že na první pohled „chytré“ nástroje mají velmi konkrétní dopady na životy lidí a tyto dopady nebývají rovnoměrně rozdělené.

AI a stereotypy

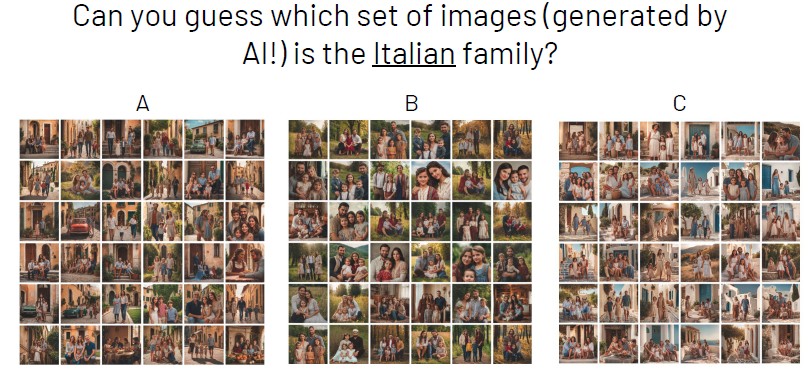

Závěrečná část nese příznačný název Stereotype Machines. Účastníci sledují, jak AI generuje obrázky rodiny nebo pracujících lidí a jak se v těchto výstupech odrážejí zažité stereotypy. V obrázcích se objevují očekávané genderové role, typické oblečení nebo prostředí, které odpovídá spíše kulturním klišé než realitě. Diskuze vede k otázce: když technologie dokáže tak snadno reprodukovat naše předsudky, jak můžeme zajistit, aby místo posilování nerovností nabízela nové, spravedlivější perspektivy?

Digitální gramotnost a knihovny

Magn(ai)fying Bias se dotýká jádra digitální gramotnosti: učí kriticky přemýšlet o technologiích, rozpoznávat skryté předsudky a chápat společenské důsledky využívání AI. Pro knihovny je workshop příležitostí otevřít téma, které přesahuje klasickou informační gramotnost. Může být použit pro školní třídy, komunitní skupiny i pro veřejné debaty o roli technologií v dnešní společnosti.

Metodika staví na aktivním zapojení účastníků, respektujícím prostředí a empatii. Díky tomu je možné workshop využít v různých kontextech, od školních tříd po komunitní centra. Zvláštní důraz se klade na propojení s materiály Data Detox Kit, zejména s částí Mirror Images [2], která se věnuje právě tématu předsudků v AI.

Závěr

Umělá inteligence není neutrální nástroj. Stejně jako naše společnost i ona odráží nerovnosti, chyby a stereotypy. Workshop Magn(ai)fying Bias proto účastníkům nabízí možnost podívat se na AI zblízka a bez iluzí, ale s důrazem na porozumění a kritické myšlení. Knihovny tak mohou být místem, kde se lidé učí vnímat, že technologie nejsou samozřejmé ani bezchybné, ale že je můžeme společně zkoumat a hledat cesty, jak je využívat spravedlivě a bezpečně.

MRÁZOVÁ, Michaela . Workshop Mang(ai)fying Bias. Duha: Informace o knihách a knihovnách [online]. 2025, 39(4) [cit. 2025-11-10]. ISSN 1804-4255. Dostupné z: https://duha.mzk.cz/clanky/workshop-mangaifying-bias

- 84 zobrazení